文献导读丨ChatGPT在科研评价中的潜在偏见:一项基于11.7万篇文献的大规模分析

发布时间:2025-10-07 阅读数:198 发布:AgilePub

近年来,以ChatGPT为代表的大型语言模型(LLM)在科学研究过程中的渗透日益深入,其应用已从辅助写作、文献梳理逐步拓展至更为核心的科研评价环节。初步证据表明,其能基于论文标题与摘要生成质量评分,且与人类专家评估结果具有一定相关性,这为其辅助甚至部分优化传统同行评议体系提供了潜在可能。然而,此类模型的“黑箱”特性及其训练数据中固有社会偏见与认知模式的潜在影响,引发了学界对其评估结果公正性与稳健性的深切担忧。针对这一问题,英国谢菲尔德大学信息学院Mike Thelwal教授及其团队在Scientometrics上发表一项大规模研究,通过对26个学科、5个时间节点逾11.7万篇文献进行分析,系统地评估了ChatGPT在科研评价中存在的潜在偏见问题。

一、研究方法

1.数据收集:从Scopus数据库26个非综合性学科类别中,选取在2003、2008、2013、2018、2023年均有发文且仅属于单一学科的期刊论文,排除摘要短于786字符的文献,共117,650篇论文纳入研究。

2.评估流程:使用GPT-4o-mini模型,并要求其根据英国科研卓越框架(REF)专家评审标准,对论文的标题和摘要进行评分。评审维度包括原创性、严谨性、显著性;评分范围:1-4分(国家级至世界领先级)。

26个学科中,2023年论文的平均得分均高于2003年。“发表年份”可解释ChatGPT评分变异的平均3.6%。这表明ChatGPT可能未充分考虑论文在其发表时代的背景与开创性价值,而是隐性地将“新近性”与“质量”关联。若直接使用原始分数,会系统性低估早期研究的价值。

2. 学科偏见

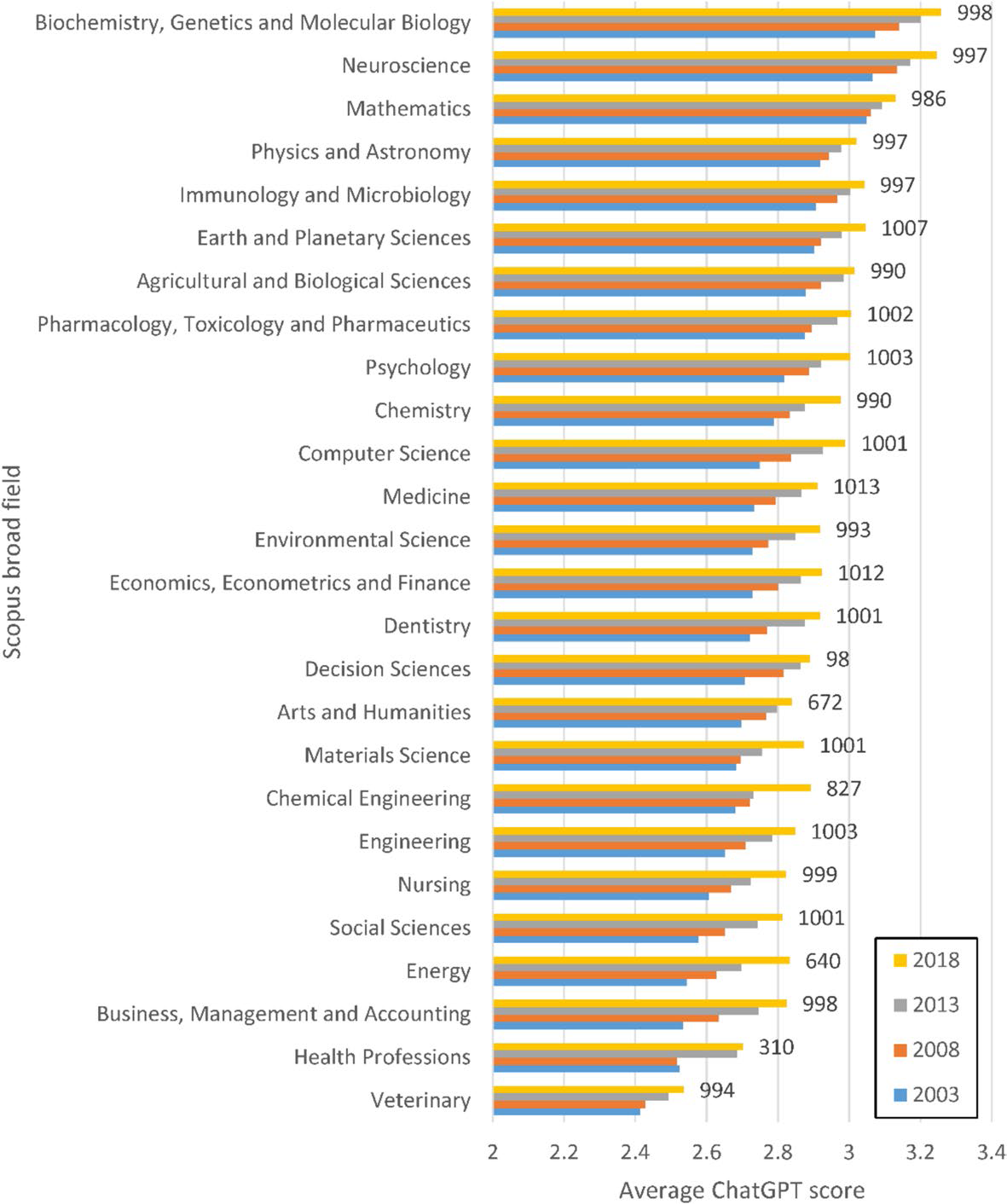

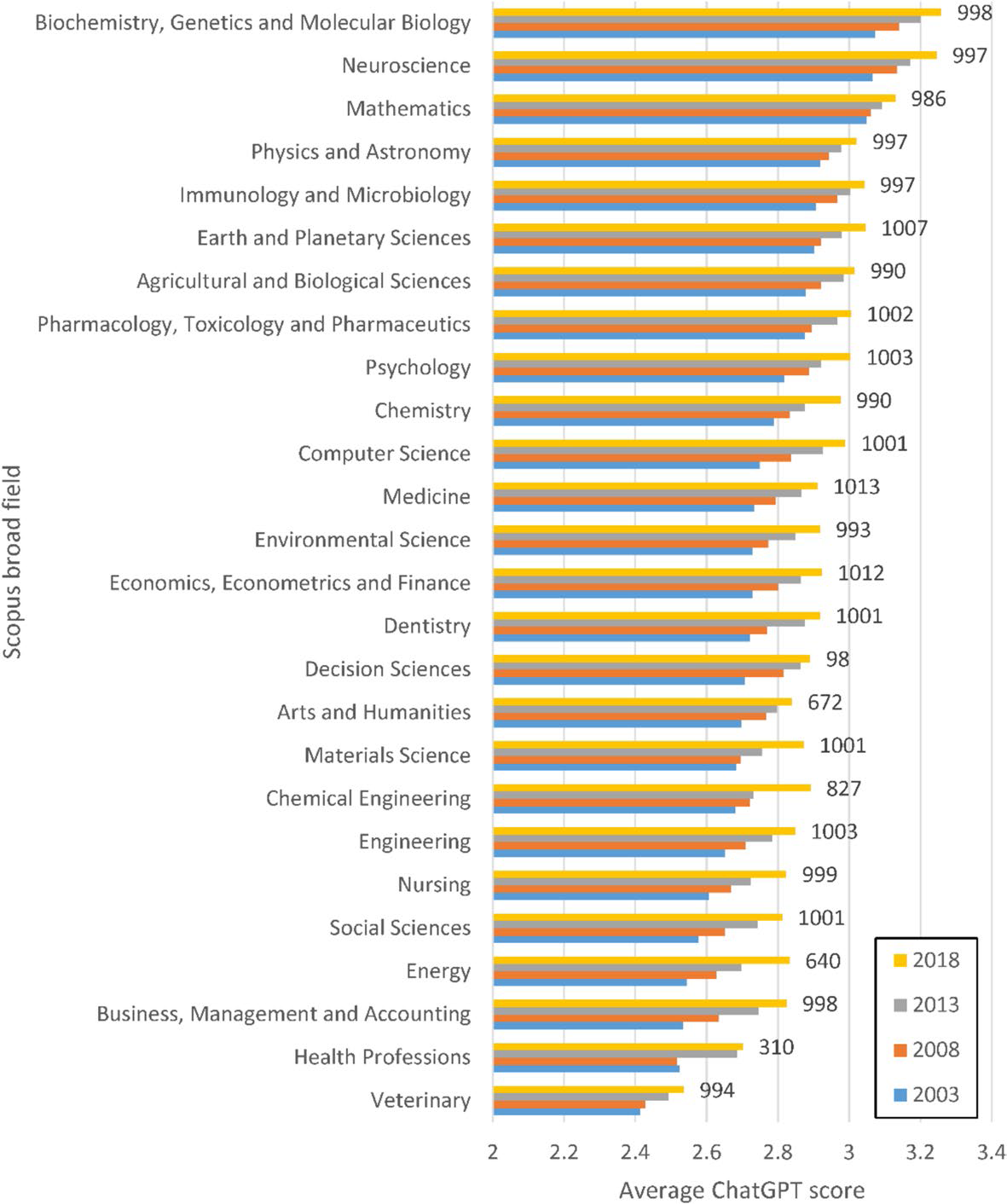

不同学科间的平均得分差异巨大(图1)。例如,“生物化学、遗传学与分子生物学”“神经科学”“数学”持续获得较高平均分,而“兽医”“健康专业”等领域则持续偏低。这提示跨学科比较必须进行学科标准化处理。

3. 长度偏见

4. 国家偏见

第一作者国籍与ChatGPT评分有关(图3),来自美国、加拿大、法国、英国等欧美国家作者的论文评分较高,而印度作者评分较低,这可能与印度的人均科研投入较低有关。此外,研究未发现语言偏见,例如未发现明确的以英语为母语国家的系统性优势。

5. 引用次数相关性

在所有研究领域中,所分析文章的引用次数与ChatGPT的评分呈正相关,不过不同领域之间的相关性存在显著差异(图4)。

三、研究局限性

三、研究局限性

1.研究样本:仅覆盖Scopus单学科期刊,未含多学科期刊论文。

2.模型版本:基于GPT-4o-mini,未来模型可能优化偏误。

3.评价标准依赖:使用英国REF框架,普适性存疑。

4.伦理漏洞:若广泛使用,作者可能通过优化摘要操纵评分。

四、研究结论

ChatGPT在科研评价中存在偏见。为确保评价的公平性与可比性,须对ChatGPT原始评分进行标准化处理,作者推荐将论文原始ChatGPT评分,除以同领域同年份论文的平均ChatGPT评分进行校正。此外,摘要长度是否需要校正仍需进一步研究。

LLMs应被视为一种强大的辅助工具,而非专家评审的替代品。最可行的应用范式是人机协同,即由模型完成初筛与量化评分,随后由领域专家对结果进行评判与最终决策。

参考文献:Thelwall, M., & Kurt, Z. (2025). Research evaluation with ChatGPT: is it age, country, length, or field biased? Scientometrics. https://doi.org/10.1007/s11192-025-05393-0

一、研究方法

1.数据收集:从Scopus数据库26个非综合性学科类别中,选取在2003、2008、2013、2018、2023年均有发文且仅属于单一学科的期刊论文,排除摘要短于786字符的文献,共117,650篇论文纳入研究。

2.评估流程:使用GPT-4o-mini模型,并要求其根据英国科研卓越框架(REF)专家评审标准,对论文的标题和摘要进行评分。评审维度包括原创性、严谨性、显著性;评分范围:1-4分(国家级至世界领先级)。

二、研究结果

1.年份偏见26个学科中,2023年论文的平均得分均高于2003年。“发表年份”可解释ChatGPT评分变异的平均3.6%。这表明ChatGPT可能未充分考虑论文在其发表时代的背景与开创性价值,而是隐性地将“新近性”与“质量”关联。若直接使用原始分数,会系统性低估早期研究的价值。

2. 学科偏见

不同学科间的平均得分差异巨大(图1)。例如,“生物化学、遗传学与分子生物学”“神经科学”“数学”持续获得较高平均分,而“兽医”“健康专业”等领域则持续偏低。这提示跨学科比较必须进行学科标准化处理。

图1 各学科领域不同发表年份论文的ChatGPT平均得分

3. 长度偏见

摘要越长,ChatGPT评分越高(平均解释3.3%得分变异)(图2)。这主要源于高影响力期刊倾向于允许或要求更长的摘要,而ChatGPT能够识别这些论文的整体质量有关。少数归因于ChatGPT自身对长文本的偏好(模型固有倾向)。

图2 不同年份和学科领域的ChatGPT评分与摘要长度(对数)的Pearson相关系数

4. 国家偏见

第一作者国籍与ChatGPT评分有关(图3),来自美国、加拿大、法国、英国等欧美国家作者的论文评分较高,而印度作者评分较低,这可能与印度的人均科研投入较低有关。此外,研究未发现语言偏见,例如未发现明确的以英语为母语国家的系统性优势。

图3 各独立变量(发表年份、题目/摘要长度、第一作者国籍)对ChatGPT评分影响的平均回归系数

5. 引用次数相关性

在所有研究领域中,所分析文章的引用次数与ChatGPT的评分呈正相关,不过不同领域之间的相关性存在显著差异(图4)。

图4 ChatGPT评分与Scopus引用次数之间的Pearson相关性分析

1.研究样本:仅覆盖Scopus单学科期刊,未含多学科期刊论文。

2.模型版本:基于GPT-4o-mini,未来模型可能优化偏误。

3.评价标准依赖:使用英国REF框架,普适性存疑。

4.伦理漏洞:若广泛使用,作者可能通过优化摘要操纵评分。

四、研究结论

ChatGPT在科研评价中存在偏见。为确保评价的公平性与可比性,须对ChatGPT原始评分进行标准化处理,作者推荐将论文原始ChatGPT评分,除以同领域同年份论文的平均ChatGPT评分进行校正。此外,摘要长度是否需要校正仍需进一步研究。

LLMs应被视为一种强大的辅助工具,而非专家评审的替代品。最可行的应用范式是人机协同,即由模型完成初筛与量化评分,随后由领域专家对结果进行评判与最终决策。

参考文献:Thelwall, M., & Kurt, Z. (2025). Research evaluation with ChatGPT: is it age, country, length, or field biased? Scientometrics. https://doi.org/10.1007/s11192-025-05393-0

相关文章

科技伦理丨《生物医学新技术临床研究和临床转化应用管理条例》解读合

2026-05-26

科技伦理丨一图读懂《生物医学新技术临床研究和临床转化应用管理条例

2026-05-26

Ctrl-Z 奖:表彰修正科学记录的研究者

2026-05-06

未来五年,科研诚信与科技伦理领域如何治理?“十五五”规划纲要梳理

2026-05-06